Ich habe kürzlich Walter Writes AI zur Inhaltserstellung ausprobiert, nachdem ich online viele unterschiedliche Meinungen dazu gesehen habe, und jetzt bin ich unsicher, was ich davon halten soll. Einige Funktionen wirkten hilfreich, aber mir sind auch Probleme bei Genauigkeit, Originalität und Workflow aufgefallen. Ich suche nach ehrlichem Feedback von Personen, die echte Erfahrungen mit Walter Writes AI haben. Ist es tatsächlich zuverlässig für eine langfristige Nutzung, oder sollte ich lieber auf ein anderes KI-Schreibtool umsteigen?

Walter Writes AI Testbericht

Ich habe einen Nachmittag damit verbracht, mit Walter Writes AI herumzuspielen, und die Ergebnisse waren extrem unterschiedlich. Die Tests zielten hauptsächlich auf Detector‑Scores, nicht auf Schreibqualität. Wenn dich also genau das interessiert, lies weiter.

Hier ist, was ich gemacht habe und was dabei herauskam.

Detector-Ergebnisse

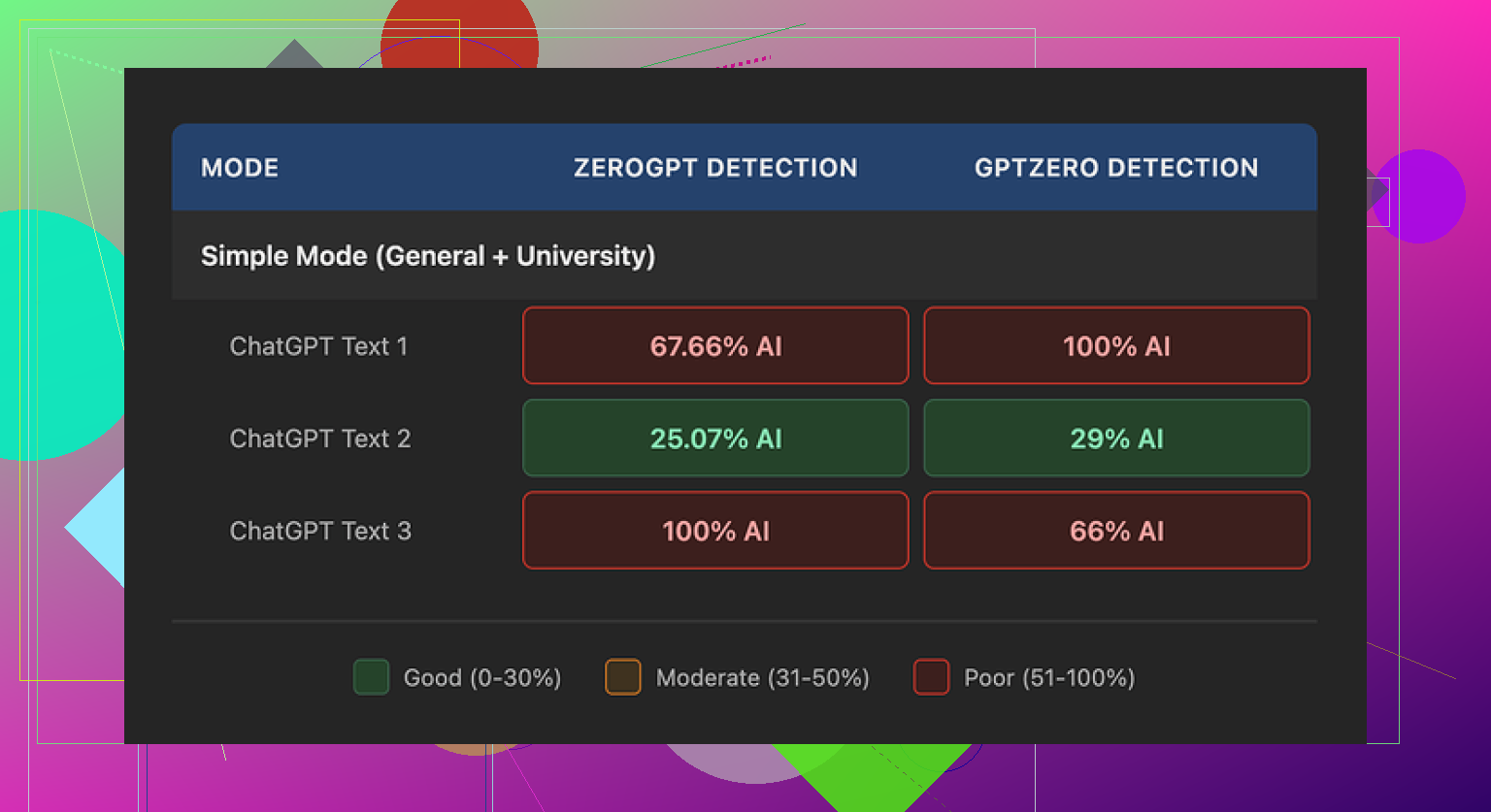

Ich habe drei verschiedene Texte mit dem kostenlosen Tarif in Walter durchgejagt, nur im Simple‑Modus. Kein Zugriff auf Standard oder Enhanced, die bleiben hinter den Bezahlplänen gesperrt.

Ab da:

-

Eine Probe kam überraschend gut heraus

- GPTZero: 29 Prozent KI

- ZeroGPT: 25 Prozent KI

Zur Einordnung: Viele kostenlose „Humanizer“ liegen deutlich höher und werden härter markiert. Dieser eine Durchlauf sah also ordentlich aus.

-

Die anderen zwei Proben waren ein Reinfall

- Jede davon landete bei mindestens einem Detector bei 100 Prozent KI

Du bekommst also diesen komischen Mix aus „ok, das hat funktioniert“ und „das ist unbrauchbar“. Das Verhalten wirkte inkonsistent, als würde das System feste Muster anwenden, die von den Detectors erkannt werden, sobald sie sich oft genug wiederholen.

- Jede davon landete bei mindestens einem Detector bei 100 Prozent KI

Hier ist derselbe Screenshot, den sie in den meisten Artikeln zeigen:

Auffällige Schreibmuster

Unabhängig von den Detector‑Scores hatte der Output ein paar ziemlich laute Hinweise. Einige Muster tauchten immer wieder auf:

-

Übermäßiger Einsatz von Semikolons

Das Tool setzte gerne Semikolons, wo eigentlich ein Komma hingehört hätte. Nach ein paar Absätzen wirkte der Text steif und unnatürlich. Wenn du viel schreibst, fällt dir das sofort auf. -

Seltsame Wiederholung kleiner Wörter

In einer Probe tauchte das Wort „heute“ viermal in drei Sätzen auf. So schreibt normalerweise niemand, außer jemand versucht krampfhaft, ein Keyword zu pushen. Es wirkte, als wäre irgendeine interne Vorlage hängen geblieben. -

Klammern-Spam

Ich bin ständig über Formulierungen wie „(z. B. Stürme, Dürren)“ gestolpert, die im Text verteilt waren und förmlich „KI“ geschrien haben. Dasselbe Muster, dieselbe Struktur, wiederholt in verschiedenen Outputs. Wenn du eine menschliche Prüfung bestehen willst, fangen solche Muster an, dir zu schaden.

Ja, das Tool hat den Text für einen guten Durchlauf bei den Detectors genug verändert, aber die Stilartefakte wirkten klar maschinell. Du müsstest kräftig nachbearbeiten, wenn du etwas einreichst, das ein menschlicher Lektor genau liest.

Preise und Limits

So sah die Preisgestaltung aus, als ich nachgesehen habe:

-

Starter‑Plan

- Etwa 8 Dollar pro Monat bei jährlicher Abrechnung

- 30.000 Wörter inklusive

-

Unlimited‑Plan

- Etwa 26 Dollar pro Monat

- Trotzdem Limit von 2.000 Wörtern pro Einreichung

„Unlimited“ bezieht sich hier also nur auf das monatliche Gesamtvolumen, nicht auf die Länge eines einzelnen Textes. Lange Texte musst du in Stücke teilen.

-

Kostenloser Tarif

- 300 Wörter insgesamt, nicht pro Nutzung

Nach ein paar Tests war das aufgebraucht. Du bekommst also keine lange Testphase, um zu sehen, wie das Tool sich bei echten Projekten verhält.

- 300 Wörter insgesamt, nicht pro Nutzung

Der Teil, bei dem ich gestutzt habe, war der Abschnitt zu Rückerstattungen und Chargebacks. Die Richtlinie enthielt ziemlich scharfe Formulierungen zu Streitfällen und sogar Drohungen mit rechtlichen Schritten bei Chargebacks. Das ist keine übliche Wortwahl für ein kleines Schreibtool und hat bei mir Warnsignale ausgelöst.

Außerdem wirkte der Umgang mit den eingereichten Textdaten vage. Ich konnte keine klaren Aussagen zur Aufbewahrungsdauer oder dazu finden, ob deine Texte fürs Training genutzt werden. Für alles Sensible ist das ein Problem.

Was für mich besser funktioniert hat

Während ich verschiedene Tools getestet habe, bin ich immer wieder bei Clever AI Humanizer gelandet. Das Tool hat konstant Texte erzeugt, die eher wie von einem Menschen geschrieben klangen, und ich musste keine Kreditkarte angeben.

Du kannst es hier ausprobieren:

Wenn du Schritt‑für‑Schritt‑Anleitungen und Beispiele von anderen Nutzerinnen und Nutzern suchst, haben mir diese geholfen:

Reddit‑Tutorial zum Humanisieren von KI‑Text:

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=de

Reddit‑Review zu Clever AI Humanizer:

https://www.reddit.com/r/DataRecoveryHelp/comments/1ptugsf/clever_ai_humanizer_review/?tl=de

YouTube‑Review:

Mein grobes Fazit nach diesen Tests: Walter Writes AI kann Detectors manchmal mit einem einzelnen Durchlauf umgehen, wirkt aber nicht stabil, die Stilauffälligkeiten sind deutlich, die Preislimits sind eng und die Formulierungen in den Richtlinien sind aggressiv. Wenn du das Risiko gering halten und natürlichere Formulierungen ohne Vorabzahlung haben willst, kam ich mit Clever AI Humanizer deutlich besser zurecht.

Ich hatte eine sehr ähnliche Reaktion auf Walter Writes AI wie du, bin aber eher bei „mit Vorsicht nutzen“ gelandet als bei „komplett skippen“.

Was für mich funktioniert hat:

- Kurze, unbedeutende Sachen. E-Mails, Produkttexte, schnelle Gliederungen.

- Wenn ich bereits ordentlichen Text eingegeben und nur um leichte Überarbeitung gebeten habe, blieb es größtenteils auf Spur.

- Die Detektor-Ergebnisse waren bei gemischten Tests manchmal ok, ähnlich wie bei dem „guten“ Beispiel, das @mikeappsreviewer gesehen hat.

Wo es auseinandergefallen ist:

-

Genauigkeit

Bei sachlichen Inhalten habe ich kleine, aber nervige Fehler gesehen. Daten leicht falsch, Zahlen seltsam gerundet, Verweise, die plausibel klangen, aber bei genauer Prüfung falsch waren. Man muss alles gegenprüfen, wenn einem Vertrauen wichtig ist. -

Originalität

Bei Plagiatsprüfungen bekam ich keine direkten Kopien angezeigt, aber die Formulierungen wirkten schablonenhaft. Immer wieder dieselben Satzmuster. Man merkt es, wenn man genug Ausgaben hintereinander liest. -

Stil-Merkmale

Ich stimme den Punkten zu Semikolons und Wiederholungen von @mikeappsreviewer zu, wobei ich bei mir eher einen übermäßigen Gebrauch von Übergangsfloskeln wie „auf der anderen Seite“ und „zusätzlich“ in fast jedem zweiten Absatz gesehen habe. Für jeden menschlichen Lektor wirkt das „nach AI“.

Außerdem hat es Nischenwörter wiederholt. Ein Artikel enthielt sechsmal „robust“ in 800 Wörtern. Das fällt Leserinnen und Lesern negativ auf. -

KI-Erkennung

Meine Tests liefen etwas anders. Ich habe denselben Blogabschnitt mit 600 Wörtern in drei Tools neu geschrieben und verglichen:

- Walter Writes AI

- Clever AI Humanizer

- Eine manuelle Überarbeitung von mir

Bei zwei populären Detektoren:

- Walter lag je nach Versuch mit derselben Vorlage zwischen 40 und 90 Prozent KI. Sehr instabil.

- Clever AI Humanizer lag für dieselbe Vorlage meist im Bereich 10 bis 35 Prozent KI und war konsistenter.

- Meine manuelle Überarbeitung erzielte überall niedrige KI-Werte.

Deshalb bin ich mit der Aussage, Walter sei nutzlos, nur bedingt einverstanden. Es ist nicht nutzlos. Es ist nur unzuverlässig, wenn dein Ziel niedrige KI-Werte und sauberen Stil sind. Du brauchst einen Plan B.

Preis und Risiko:

- Die Wortlimits sind knapp, wenn du viel Langform-Inhalt bearbeitest.

- Die scharfe Rückerstattungs- und Chargeback-Sprache, die du schon gesehen hast, ist für mich ebenfalls ein Warnsignal. Ich vermeide es, Kundenprojekte in Tools zu stecken, die vage mit Daten umgehen und in ihren AGB mit rechtlichen Drohungen arbeiten.

Was ich an deiner Stelle tun würde:

- Priorität festlegen

- Wenn dir Qualität wichtig ist und ein menschlicher Lektor deine Texte sieht, nutze Walter nur als Helfer. Lass es grob gliedern oder Ideen liefern und schreibe dann in deiner eigenen Stimme stark um.

- Wenn dir Detektor-Ergebnisse und eine geringere KI-Wahrscheinlichkeit wichtiger sind, jag deinen Entwurf durch etwas wie Clever AI Humanizer und überarbeite anschließend Sätze per Hand, die unnatürlich klingen.

- Einen Workflow aufsetzen

Beispielablauf, der für mich ganz gut funktionierte:

- Entwurf in einem normalen KI-Tool oder von Hand schreiben.

- Walter nur verwenden für: einen Absatz zur Klarheit umschreiben, kürzen oder erweitern.

- Das Ergebnis bei Bedarf durch Clever AI Humanizer für einen abschließenden „Ent-AI“-Durchgang schicken.

- Einen schnellen manuellen Check auf seltsame Formulierungen, Wiederholungen und Faktenfehler machen.

- Hochrisiko-Fälle meiden

Ich würde keine akademischen Arbeiten, juristischen Dokumente, sensiblen Business-Dokumente oder irgendetwas unter NDAs durch Walter schicken. Die Richtlinien und der Umgang mit Daten sind dafür zu undurchsichtig.

TLDR:

- Walter Writes AI ist als grober Helfer für Inhalte mit niedrigem Risiko in Ordnung.

- Es ist schwach als One-Click-Lösung für präzise, originelle, menschlich wirkende Texte.

- Wenn du einen SEO-freundlichen Humanizer willst, der Detektoren tendenziell besser bedient, lohnt sich ein Test mit Clever AI Humanizer im Direktvergleich.

- Egal was du wählst, plane viel Nachbearbeitung ein. Kein Tool liefert derzeit sichere, originelle und detektionsfreundliche Texte ohne menschlichen Feinschliff.

Ich bin bei Walter auch eher in der Mitte, aber aus etwas anderen Gründen als @mikeappsreviewer und @techchizkid.

Kurzfassung: Es ist nutzbar, aber nur, wenn du es als Rohentwurf-Maschine behandelst und nicht als „Knopf drücken, veröffentlichungsfertigen Inhalt bekommen“-Tool.

Was du bei Genauigkeit und Originalität beobachtet hast, deckt sich mit meinen Erfahrungen, aber ich finde ehrlich gesagt, dass das größere Problem ist, wie „schablonenhaft“ sich die Stimme mit der Zeit anfühlt. Nach 3–4 Texten klingt alles, als würde derselbe Blogger verzweifelt ein Wortziel erreichen wollen. Selbst wenn Plagiatsprüfungen sagen, es sei „einzigartig“, fühlt es sich trotzdem kreativ recycelt an. Überall dort, wo dein Name oder deine Marke druntersteht, nervt das sehr schnell.

Ein paar Punkte, bei denen ich den beiden anderen leicht widerspreche:

- Ich finde nicht, dass die schwankenden Detector-Scores das Hauptproblem sind. Detector-Tools sind ohnehin unzuverlässig. Ich würde mir mehr Sorgen machen, dass menschliche Leser die roboterhafte Formulierung merken, als ob irgendeine Seite 30 % oder 70 % KI ausspuckt.

- Bei den AGB bin ich etwas weniger nachsichtig. Aggressive Chargeback-Formulierungen + unklare Datenspeicherung sind für Kundenprojekte für mich ein klares Nein. Das ist nicht nur „mit Vorsicht verwenden“, das ist eher „fernhalten von allem, was sensibel ist“.

Wo Walter für mich tatsächlich funktioniert hat:

- Ideen-Dumping, wenn ich feststeckte. Ich habe einen chaotischen Absatz hineingeworfen und es gebeten, den zu strukturieren oder auszubauen, um das Ergebnis dann in meiner eigenen Stimme umzuschreiben.

- Sehr kurze Inhalte, bei denen der Ton nicht so wichtig ist, wie schnelle Tooltips, UI-Microcopy oder Platzhaltertexte.

Wo ich es meiden würde:

- Alles Faktische, das Quellenangaben oder exakte Zahlen braucht. Zu viele „fast, aber nicht ganz“-Details.

- Längere Meinungs- oder Analysestücke. Je länger der Output, desto offensichtlicher werden Wiederholungen und Standard-Übergänge.

- Akademische oder juristische Inhalte. In Kombination aus Genauigkeit und Datenrichtlinien ist das einfach ein Risiko.

Wenn deine Hauptsorge AI-Erkennung und „das liest sich zu robotic“ ist, würde ich Walter ehrlich gesagt früher im Workflow einsetzen und etwas wie Clever AI Humanizer für den Feinschliff verwenden. Walter für die grobe Struktur, dann Clever AI Humanizer, um die Sprache zu glätten und die offensichtlichen KI-Muster zu reduzieren. Manuelle Nachbearbeitung brauchst du trotzdem, aber du kämpfst zumindest nicht ständig mit denselben Semikolon-/Wiederholungs-Macken.

Ich würde Walter also nicht komplett wegwerfen, aber ich würde aufhören zu erwarten, dass es dein Haupt-Texter ist. Behandle es wie einen etwas unbeholfenen Assistenten und stecke deine eigentliche Arbeit in Überarbeitung und Fact-Checking.